Wordcloudy v různých typech médií

Společnost Newton Media shromáždila monitorováním více než tří tisíc vydavatelů a jejich různých zpravodajských kanálů přes milion mediálních zpráv o COVID-19. Wordcloudy vznikají díky využití metod dolování dat aplikovaných na texty zpráv v kombinaci se základními postupy zpracování přirozeného jazyka se zaměřením na specifiku českého jazyka.

Jak vznikají wordcloudy?

Mediální zprávy jsou firmou Newton Media získávány z mnoha zpravodajských zdrojů. Jsou monitorovány jak tištěné formy deníků a časopisů, které se z jejich různých, např. elektronických, forem převádí manuálně, poloautomatizovaně, či plně automatizovaně do normalizovaného tvaru obsahujícího jak vlastní text, tak i jeho metadata. Velké množství zpráv se získává přímo z online webových stránek vydavatelů, v nichž se textové a obrazové části obsahu zprávy identifikují technikami tzv. data scraping, a poté kopírují do speciálního úložiště. Podobně se monitorují i řečové kanály rozhlasových a televizních stanic, které se technikami rozpoznávání řeči převádí opět na text.

Úložiště umožňuje efektivně ukládat násobné výskyty zpráv, které jsou se stejným obsahem publikovány v různých variantách zpravodajských kanálů příslušného vydavatele. Například některé regionální deníky přebírají základní centrálně vytvořený vzor a doplní na vybraná místa speciální zprávy týkající se daného konkrétního regionu. Tento fakt je potřeba zohlednit při vytváření statistik, proto jsou např. v současném exportu zpráv takové zprávy uvedeny pouze jednou. Je potřeba i podotknout, že ačkoliv firma Newton Media řadu dalších zpravodajských kanálů monitoruje, tak ne všechny zdroje či relace jsou archivovány.

Mezi analyzované texty byla zpráva zařazena, pokud obsahovala alespoň části slov s problematikou onemocnění COVID-19 související. Vzhledem k různým inflexím českých slov se vyhledávají všechny možné varianty přípon. Technicky se takový dotaz řeší pomocí tzv. regulárních výrazů, kdy znak * zastupuje libovolný řetězec znaků, v našem případě nějakou příponu slova. Výsledný dotaz je poměrně komplikovaný, ale pro jednoduchost můžeme uvést, že se hledají v principu následující slova: covi*, koron*, coron*, epidem*, pandem*, vir*, onemocnění*, zápal*, plic*, netopý*, sars*, karantén*, wuchan*, infek*, infik*, lékař*, zdravot*, šest*, nákaz*, nakaž*, vakcín*, čín*, lockdown*. Při exportu dat se obsah zpráv doplňuje o metadata a ve formě několika souborů komprimovaných pomocí ZIP techniky tak tvoří vstupní data do výpočetního procesu provádějící vlastní analýzu zaměřenou na problematiku projektu Infodemie.

Analýza dedikovaná hodnocení zaměření obsahu zpráv a jejich průběžných změn během vývoje pandemie pomocí wordcloudů je zahájena vytvořením přehledu, jak příslušný mediální zdroj používal jednotlivá slova v určitém měsíci. Před vytvořením přehledu se text zprávy upraví. Eliminují se všechny speciální znaky, které netvoří slova. Rovněž se v přehledu neuvažují čísla. Do tohoto přehledu nejsou zahrnuta slova zařazená mezi tzv. stopwords. Tato hojně se vyskytující slova typicky přispívají pouze do vytvoření syntaktické struktury věty tím, že vytváří vazby s dalšími slovy, ale hodnocení sémantického obsahu založeného pouze na slovech ovlivňují už mnohem méně.

Tzv. stopwords jsou navíc doplněna vybranými zájmeny a dalšími slovy, která se pouze odkazují na další slova, která však mohou být od takových zájmen poměrně již hodně v textu vzdálená. V rámci analýzy pomocí wordcloud diagramů jsme vyloučili i slova „koronavirus“, „koronavir“, neboť zprávy byly vybrány s ohledem na tato slova, a názvy vybraných médií, např. „irozhlas“, „blesk“, „seznam“, „právo“, „právu“, „nova“, „tn“, „hn“, „televize“, „já“, „cz“. Tato zřejmá častá slova jsou jinak v diagramech uvedena jako nejčastější, a tudíž největší, a zbytečně proto zabírají místo ostatním slovům. Všechna slova se normalizují na použití pouze malých písmen. Další normalizace českého textu v analýze v současné době neprovádíme.

Podle cíleného diagramu se pak příslušným příkazem z databáze vybere frekvenční tabulka výskytů slov pro zvolenou množinu mediálních zdrojů a analyzované období a konstruují se wordcloudy. V diagramu se přibližně dvěma stovkám nejfrekventovanějších slov podle počtu výskytů slov nebo podle počtu zpráv obsahující takové slovo přiřadí velikost fontu a barva podle vybrané škály použité barevné palety. Posledním krokem je umístění obarvených slov s přiřazenou velikostí fontu do diagramu. Existuje řada metod, které se liší i kvalitou výsledků. V našem projektu používáme knihovnu Wordcloud implementovanou v jazyce Python.

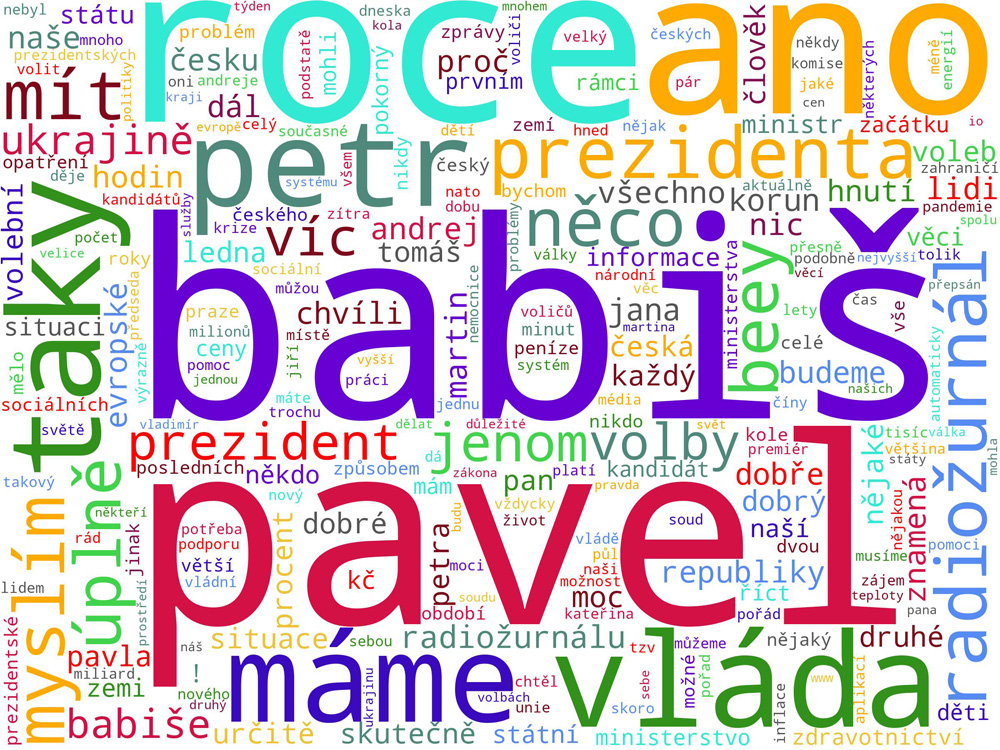

Aktuální wordcloud

(kompletní mediální monitoring,

leden 2023 / 15 888 zpráv)